从零开始:Ubuntu 系统下搭建 LLaMA-Factory 微调环境 + CUDA 驱动配置(保姆级图文)

LLaMA-Factory 是一个功能强大且用户友好的开源工具,旨在简化 LLaMA、ChatGLM、Qwen 等多种主流大模型的微调(Fine-tuning)与部署流程。本文将详细介绍如何在本地机器上部署 LLaMA-Factory,并正确配置 CUDA 环境以充分利用 GPU 进行加速。

1

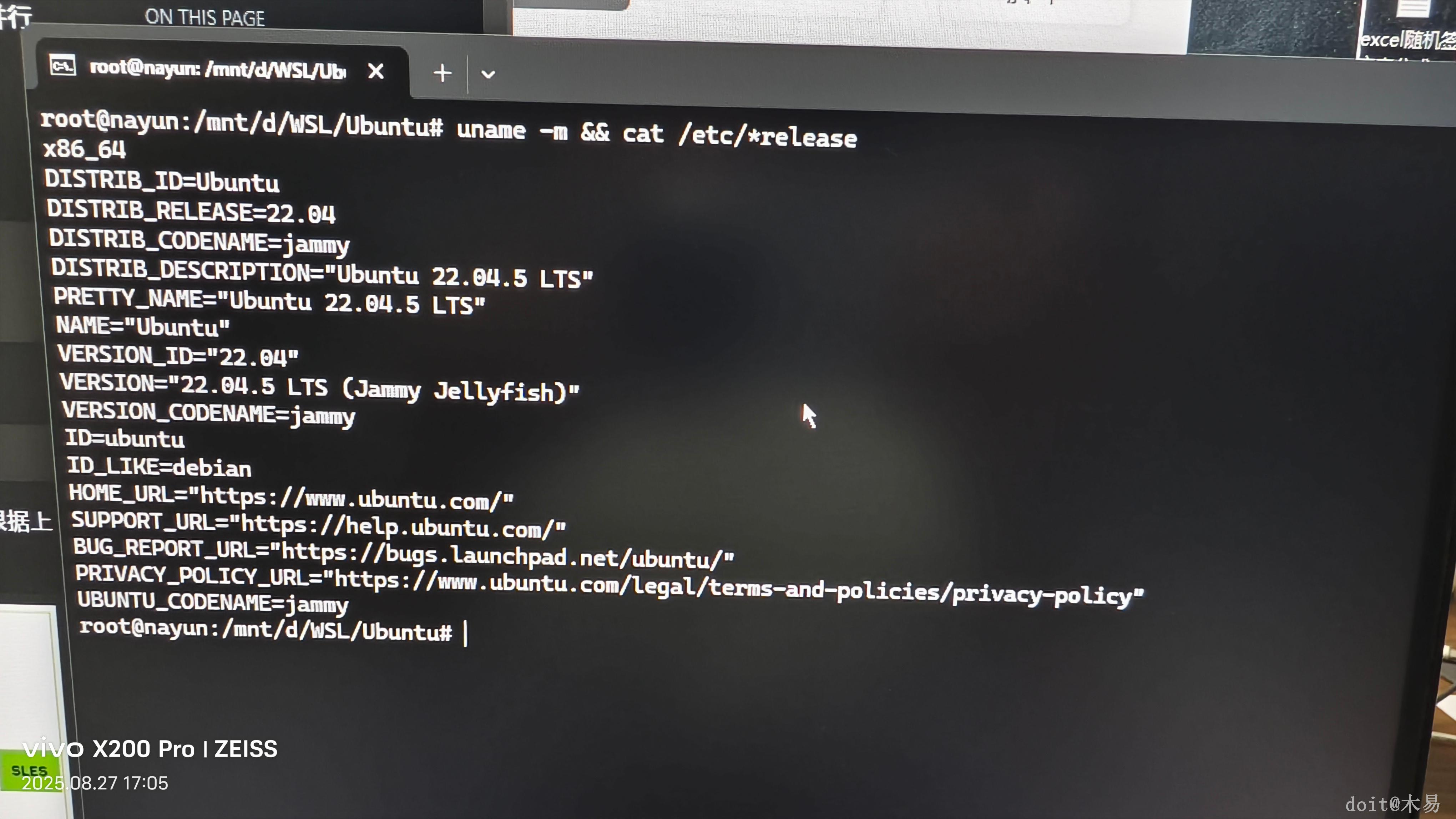

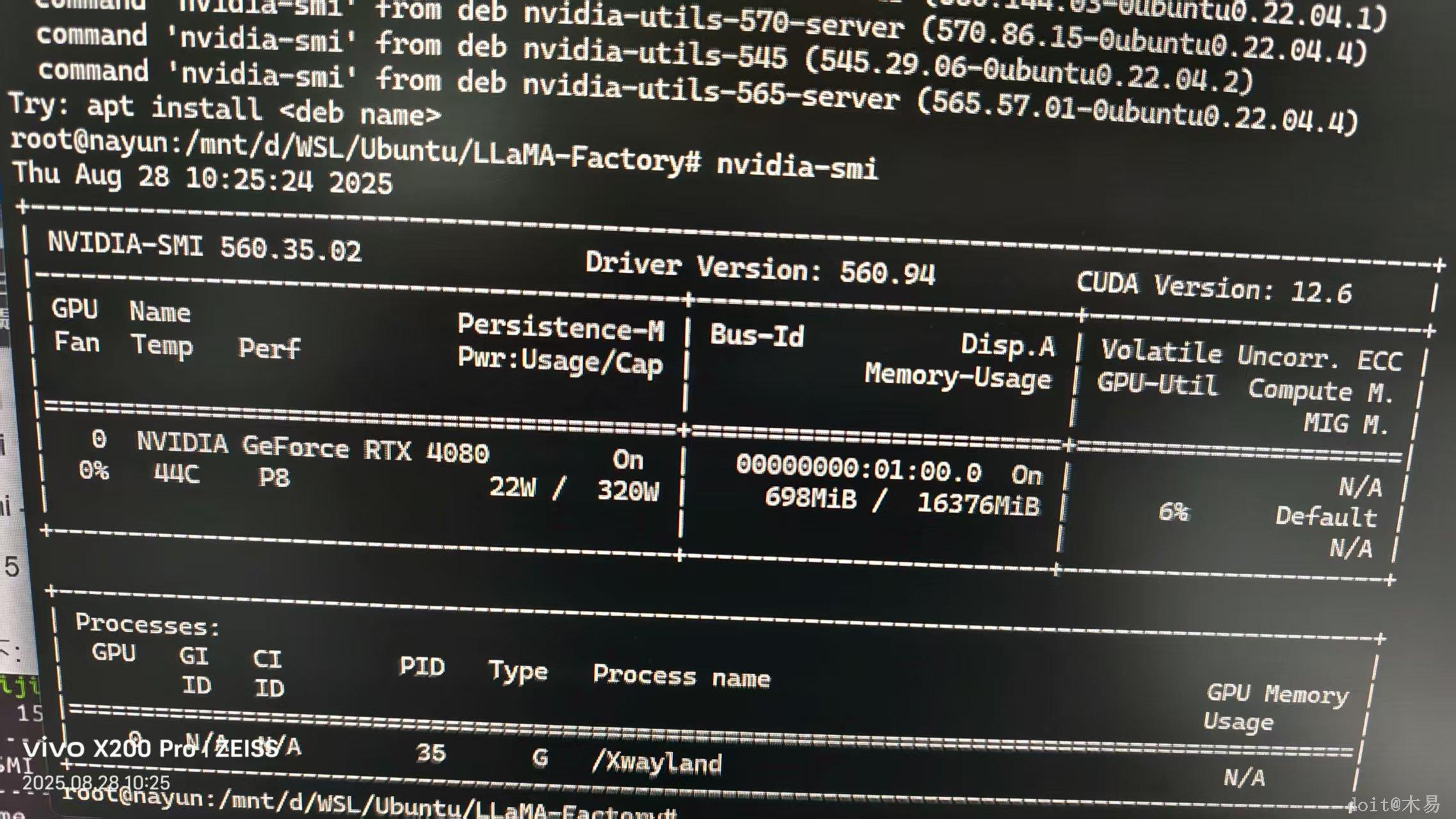

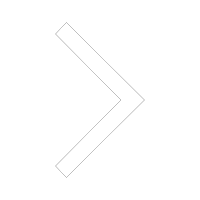

前置准备

2

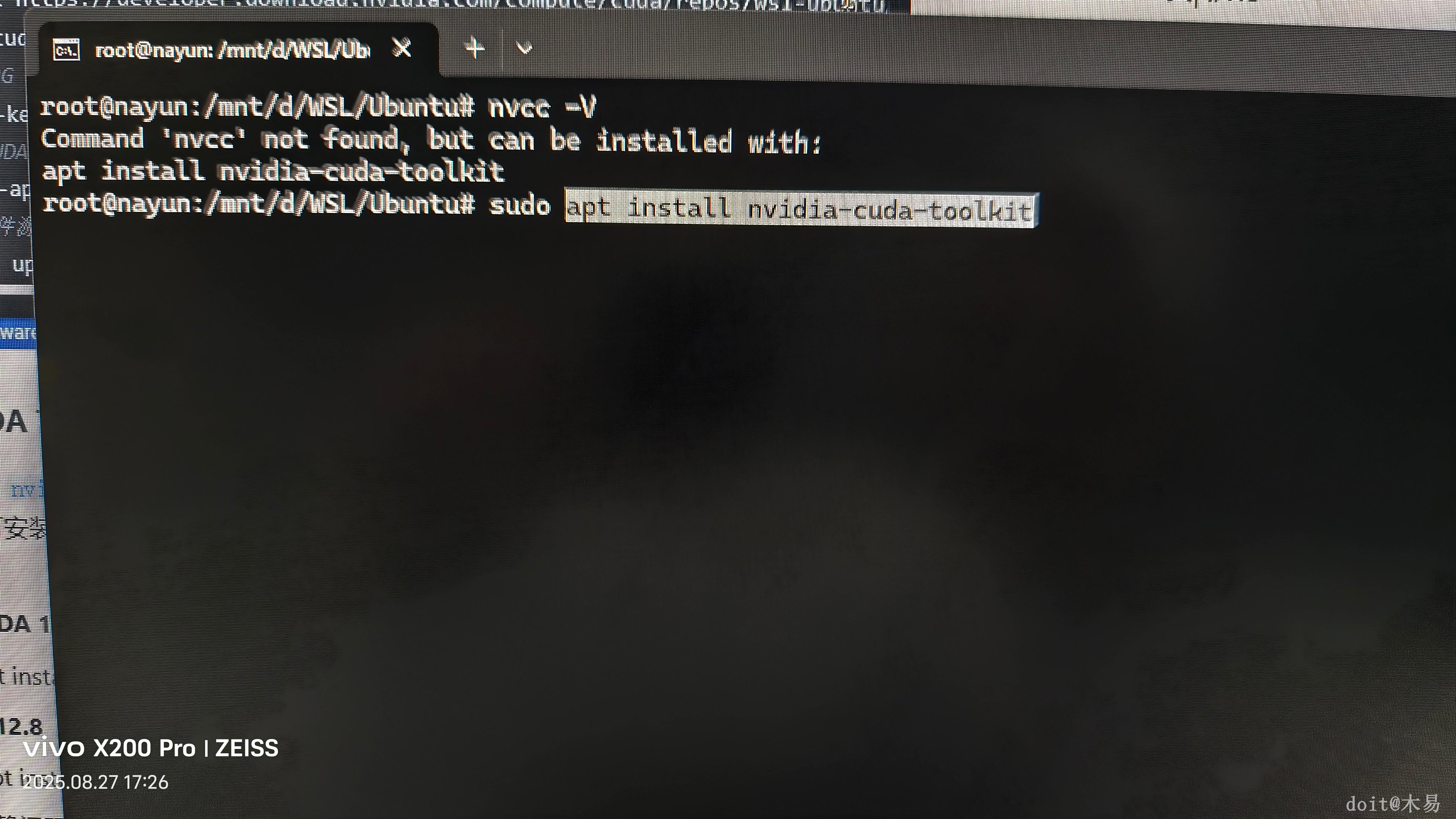

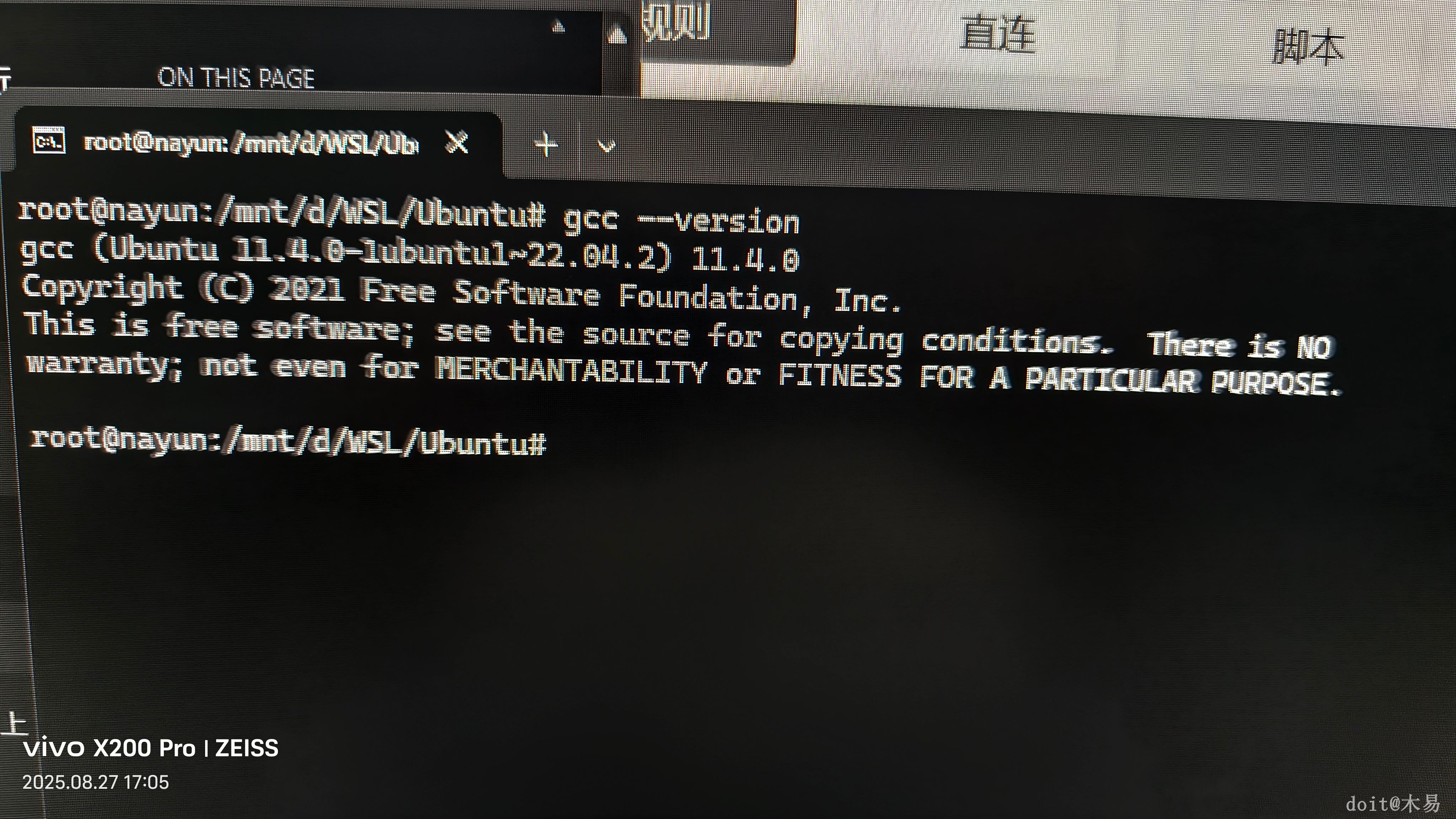

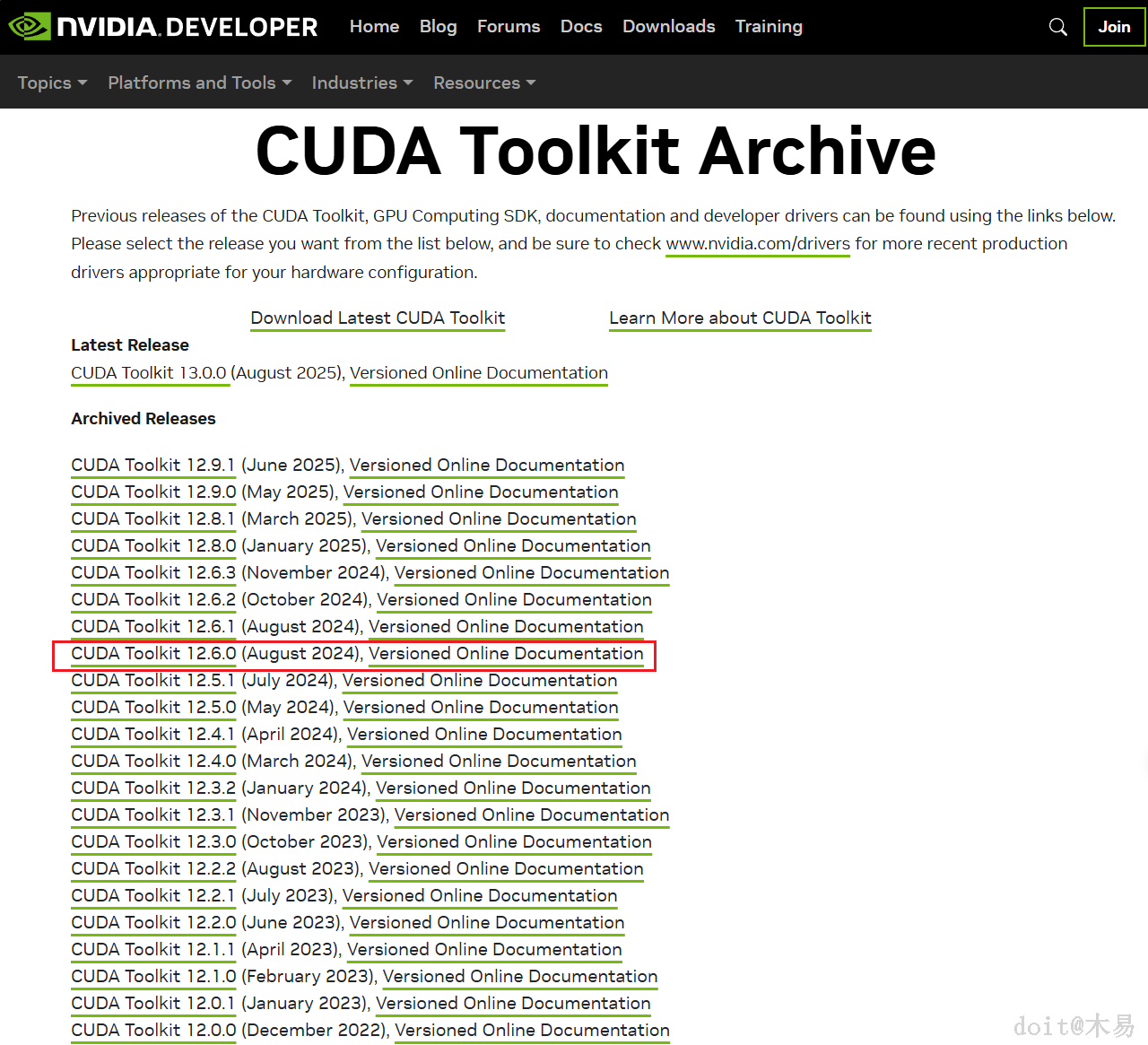

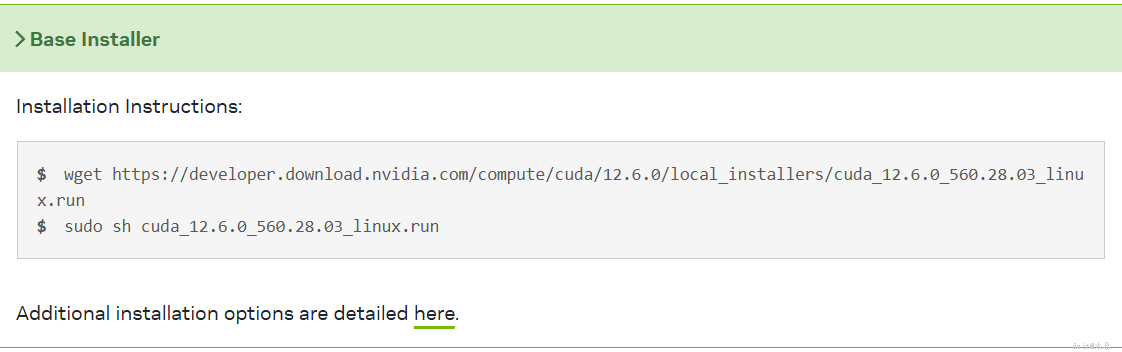

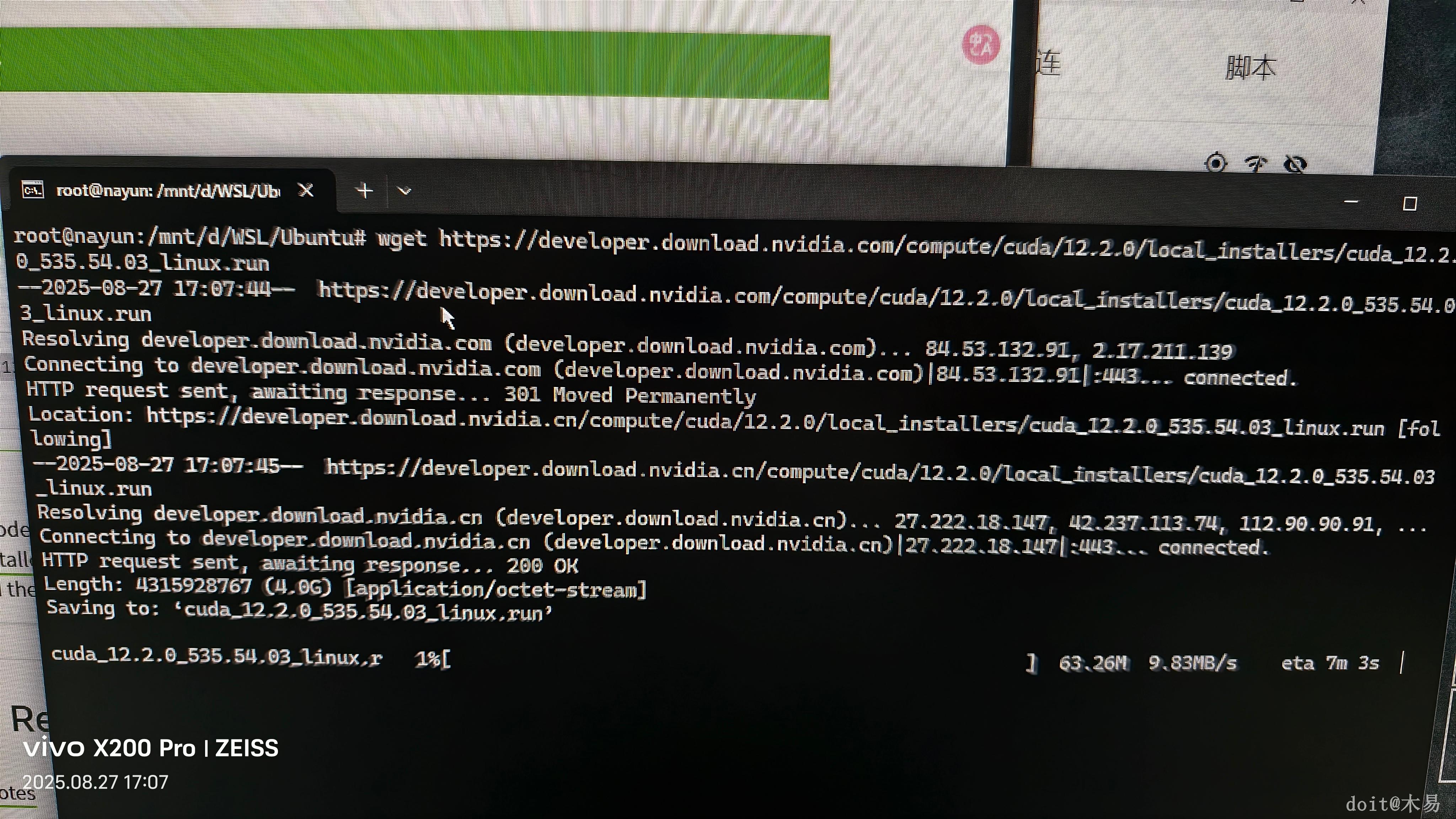

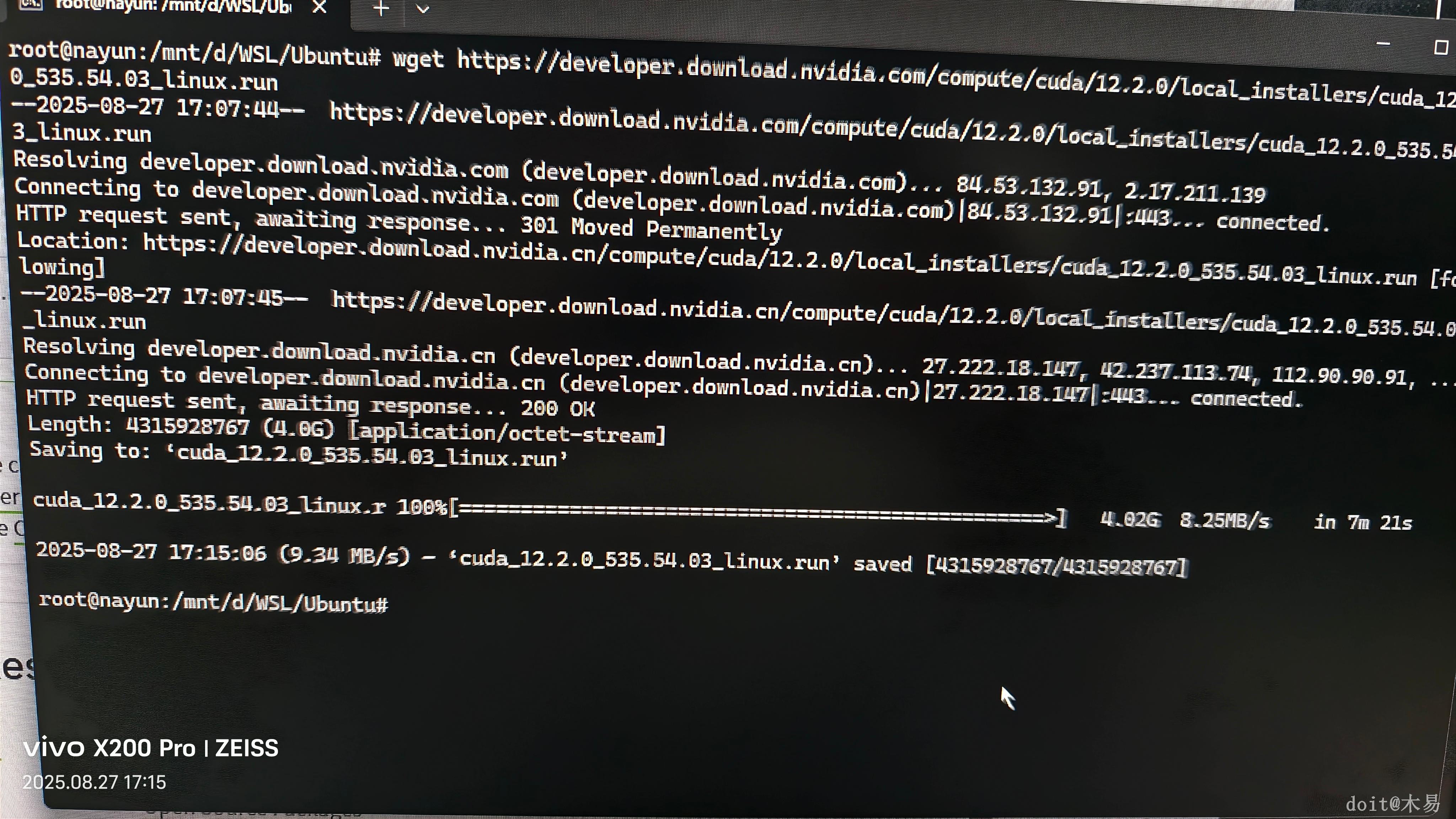

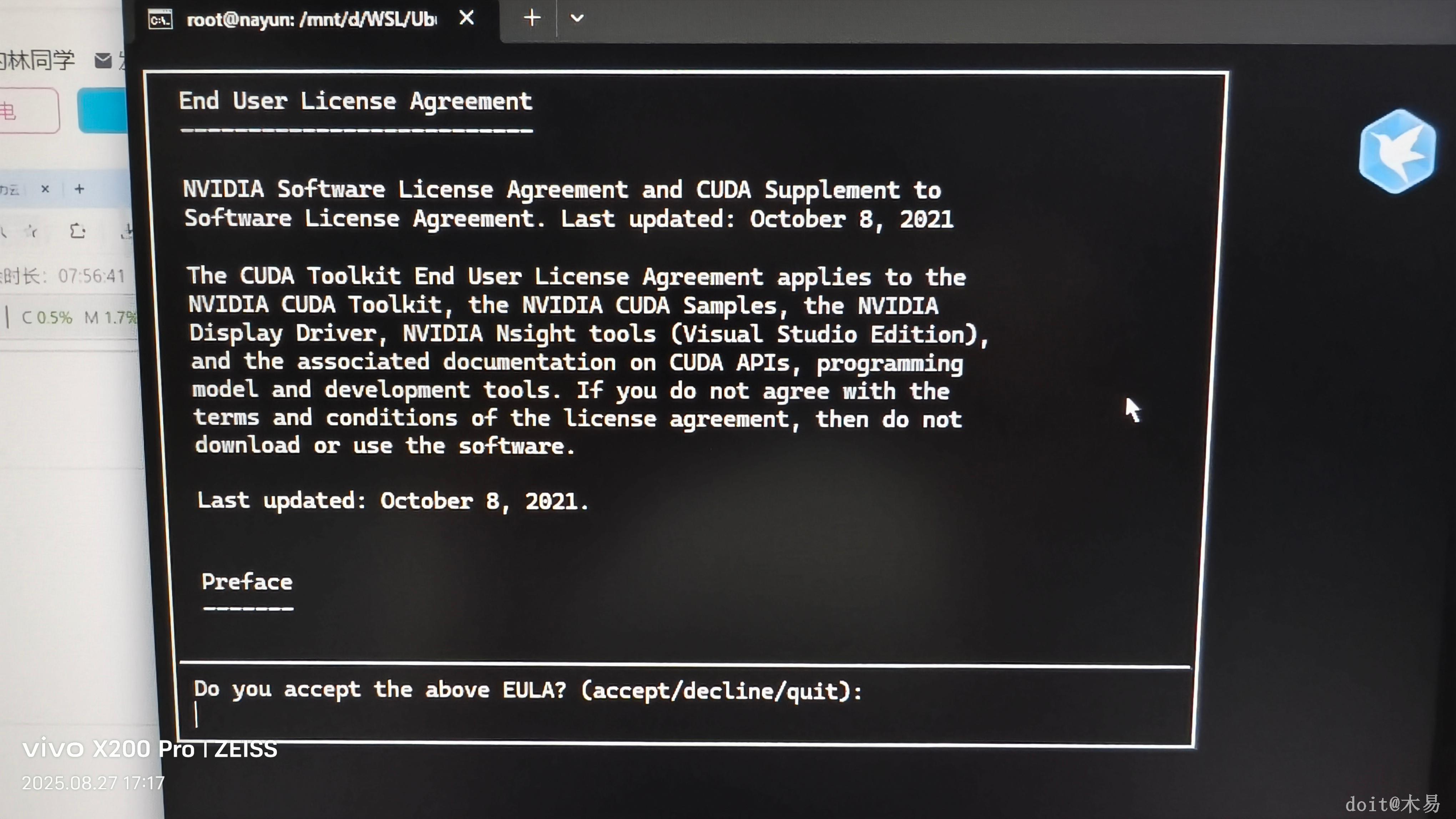

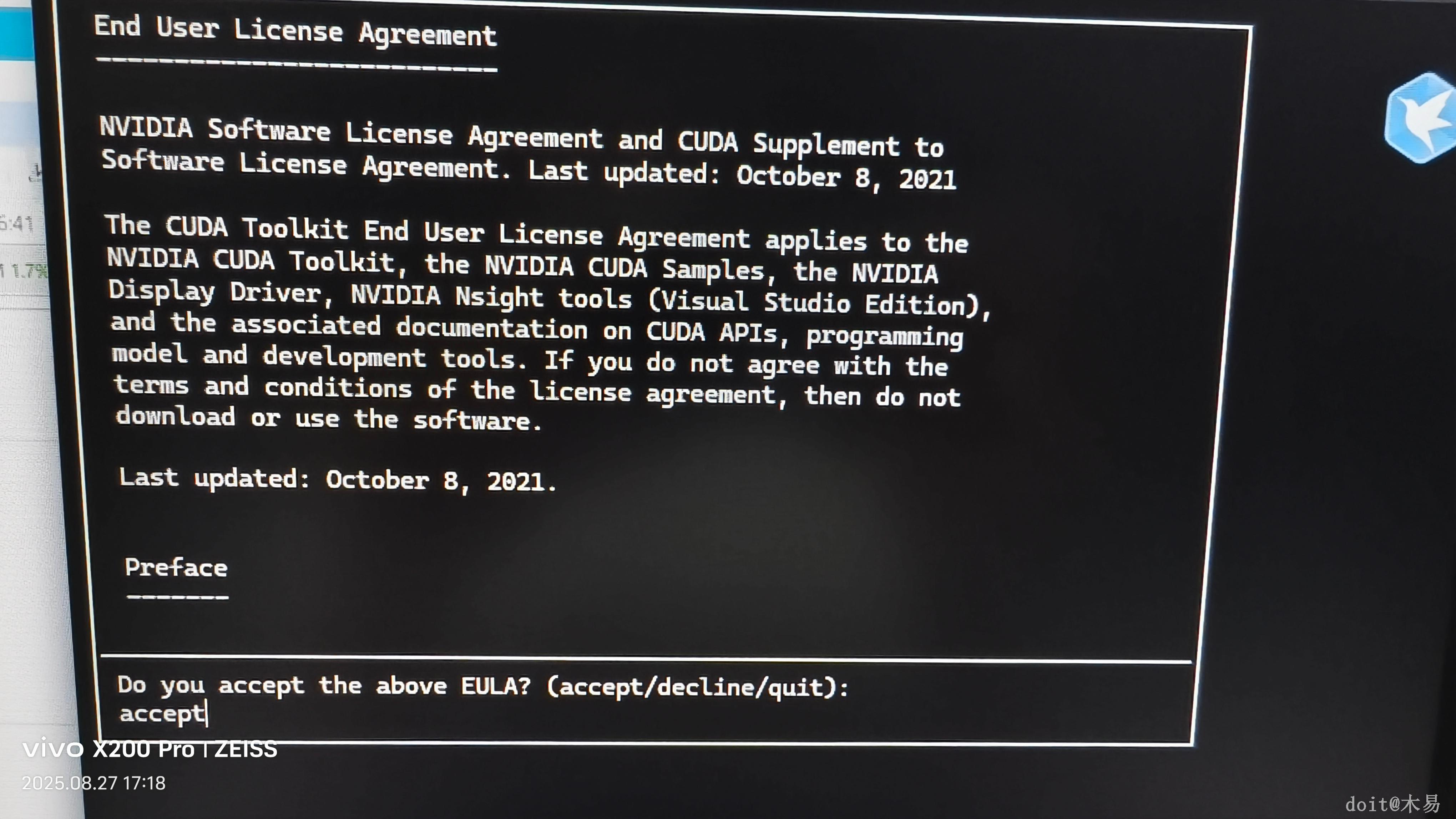

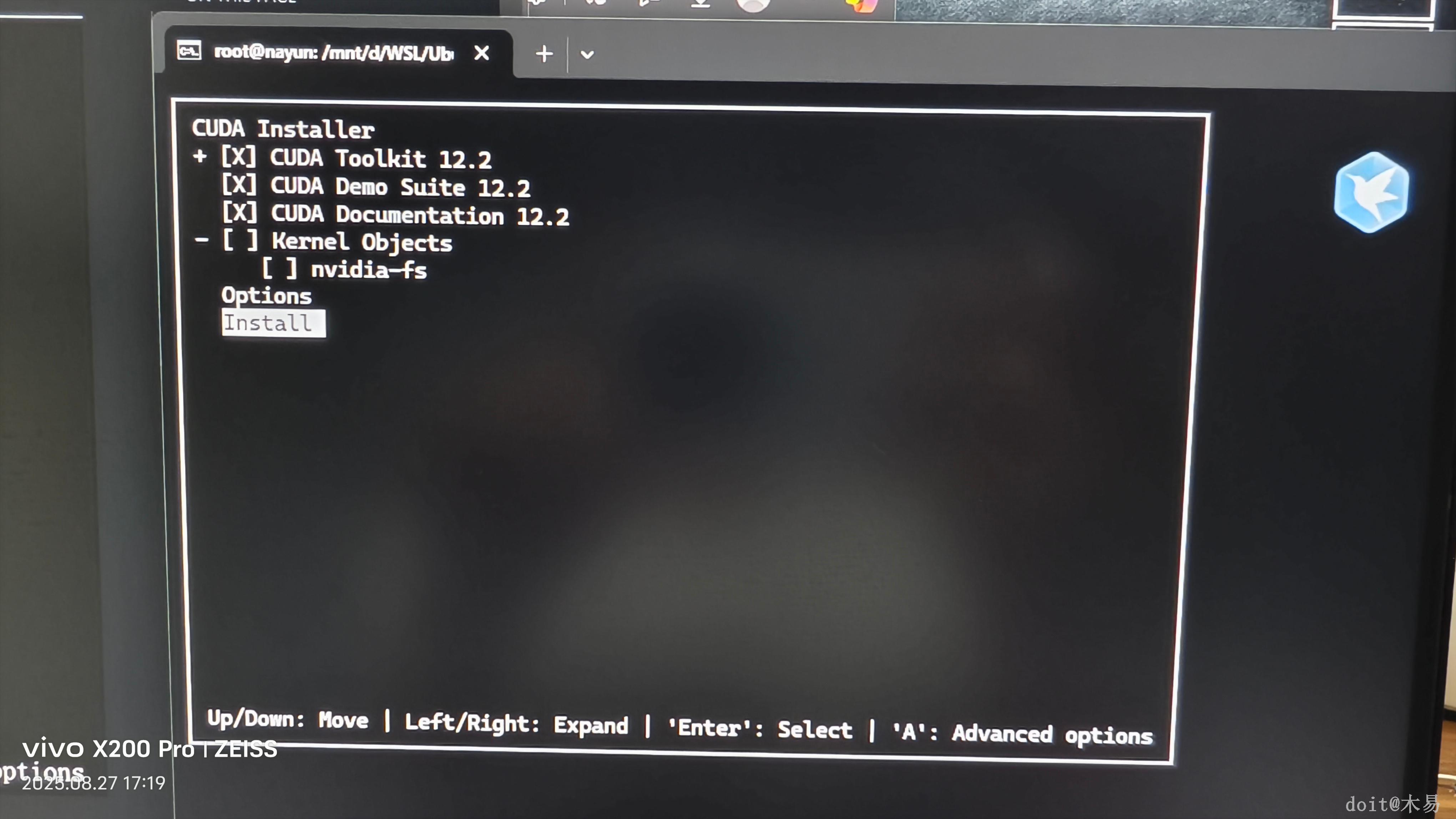

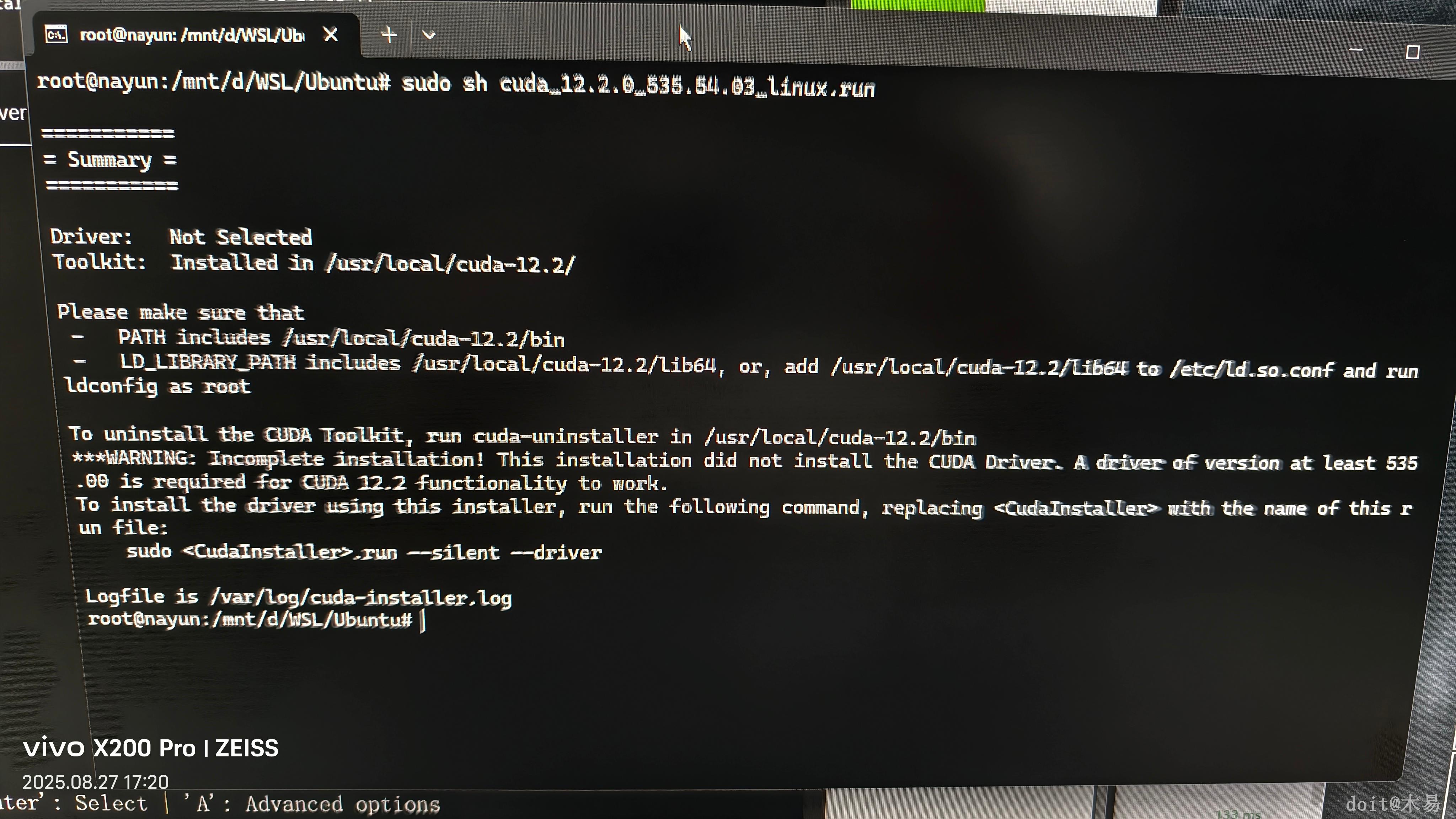

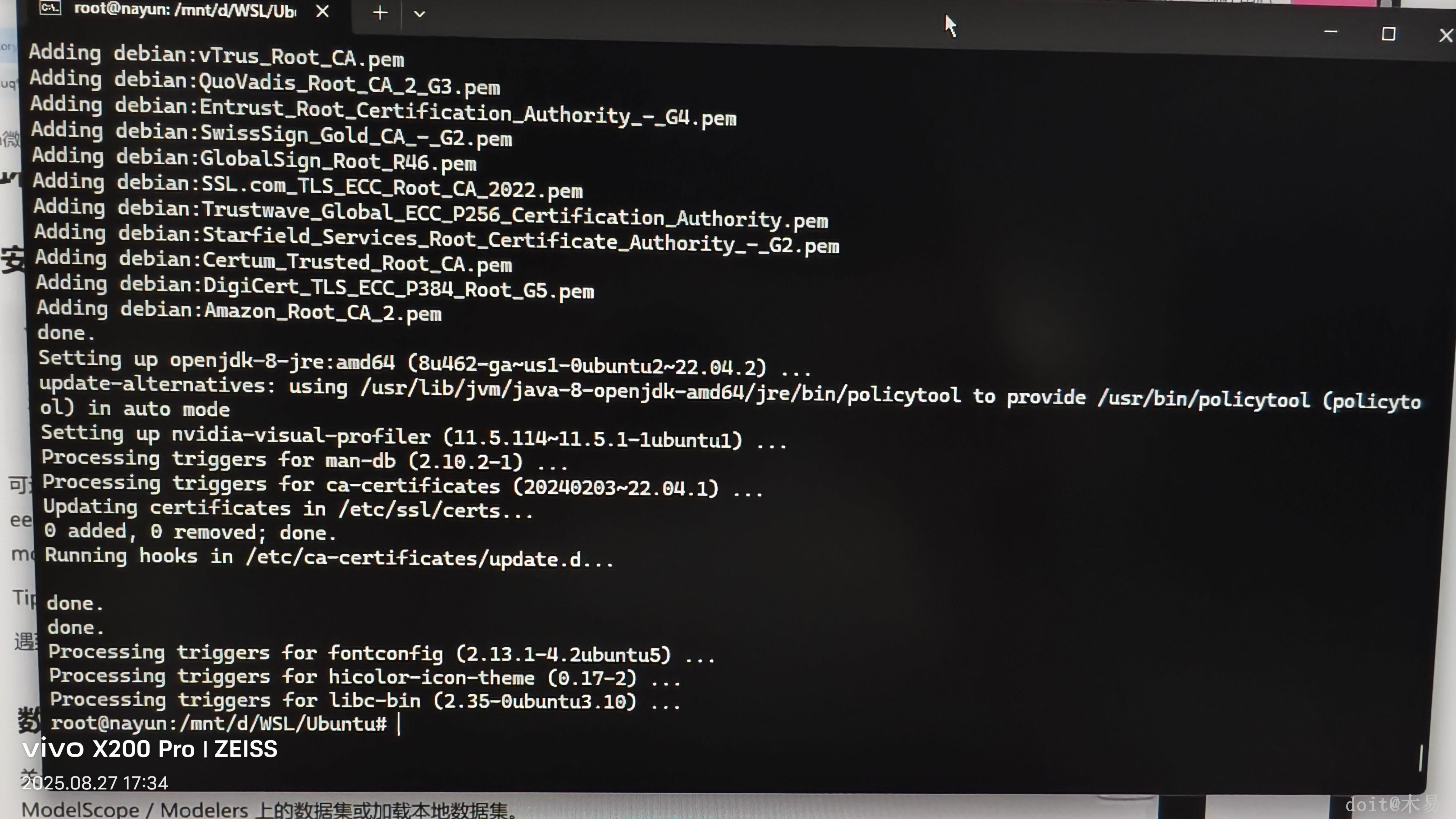

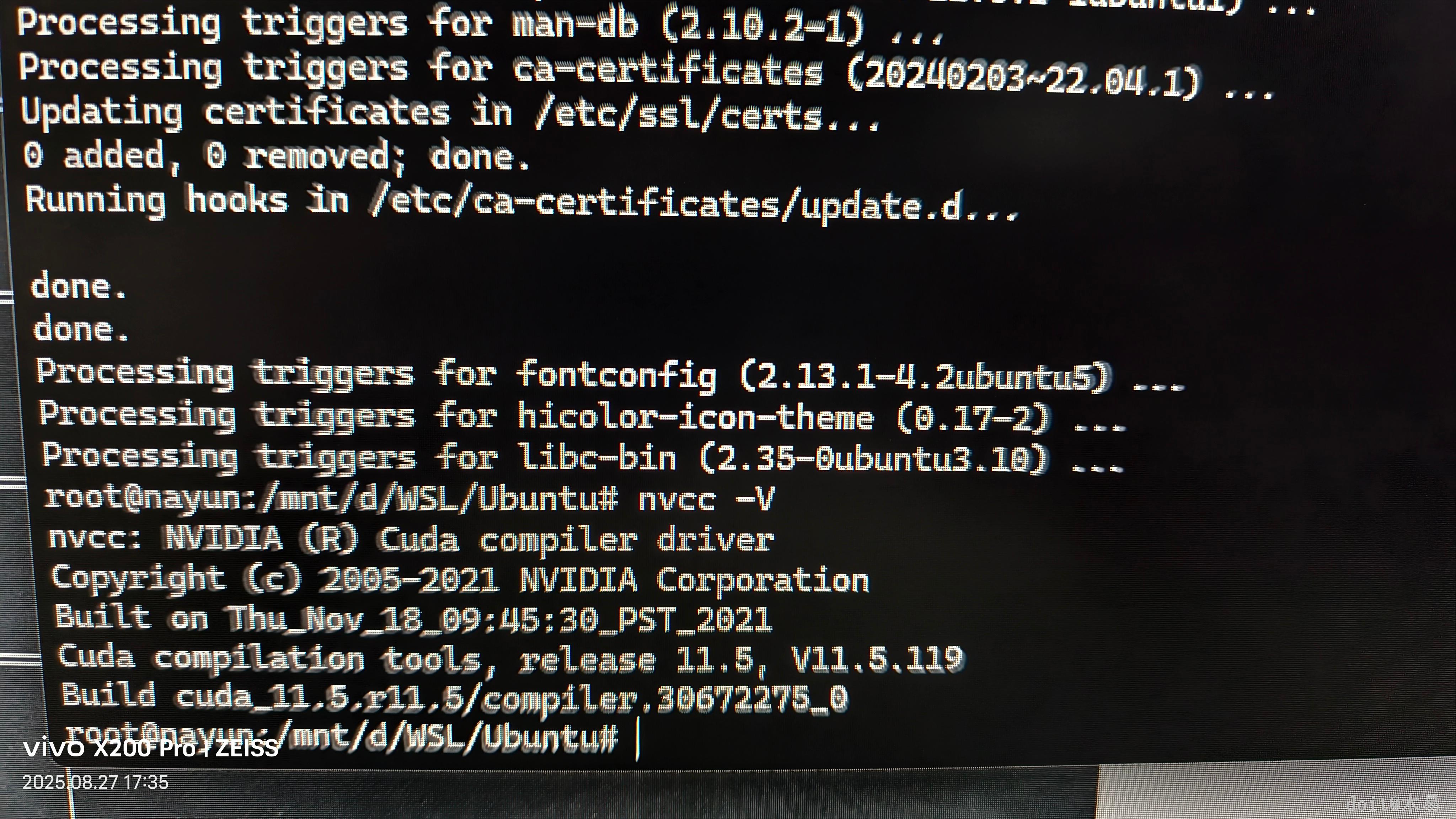

安装cuda

3

查看是否安装成功

4

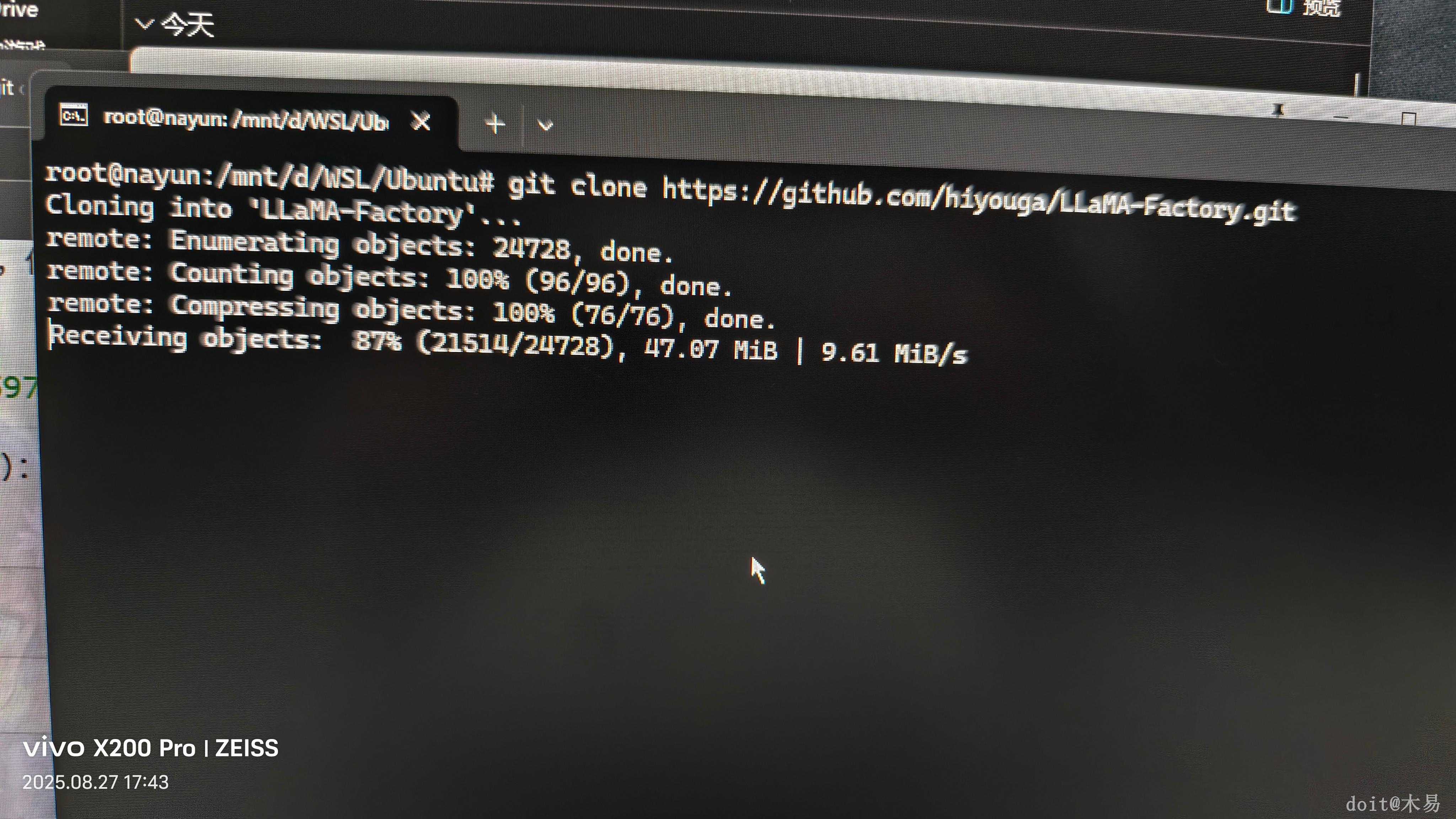

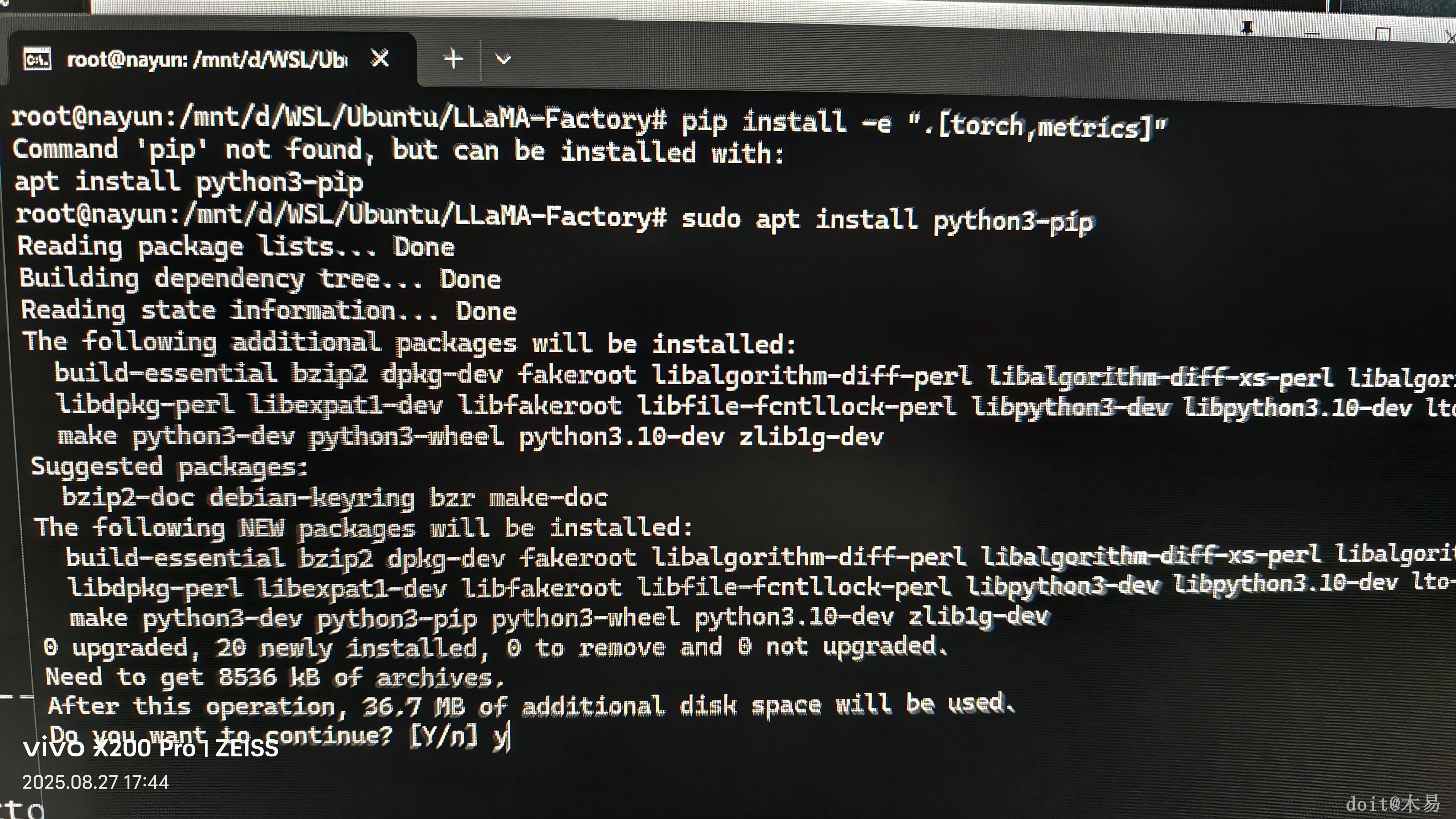

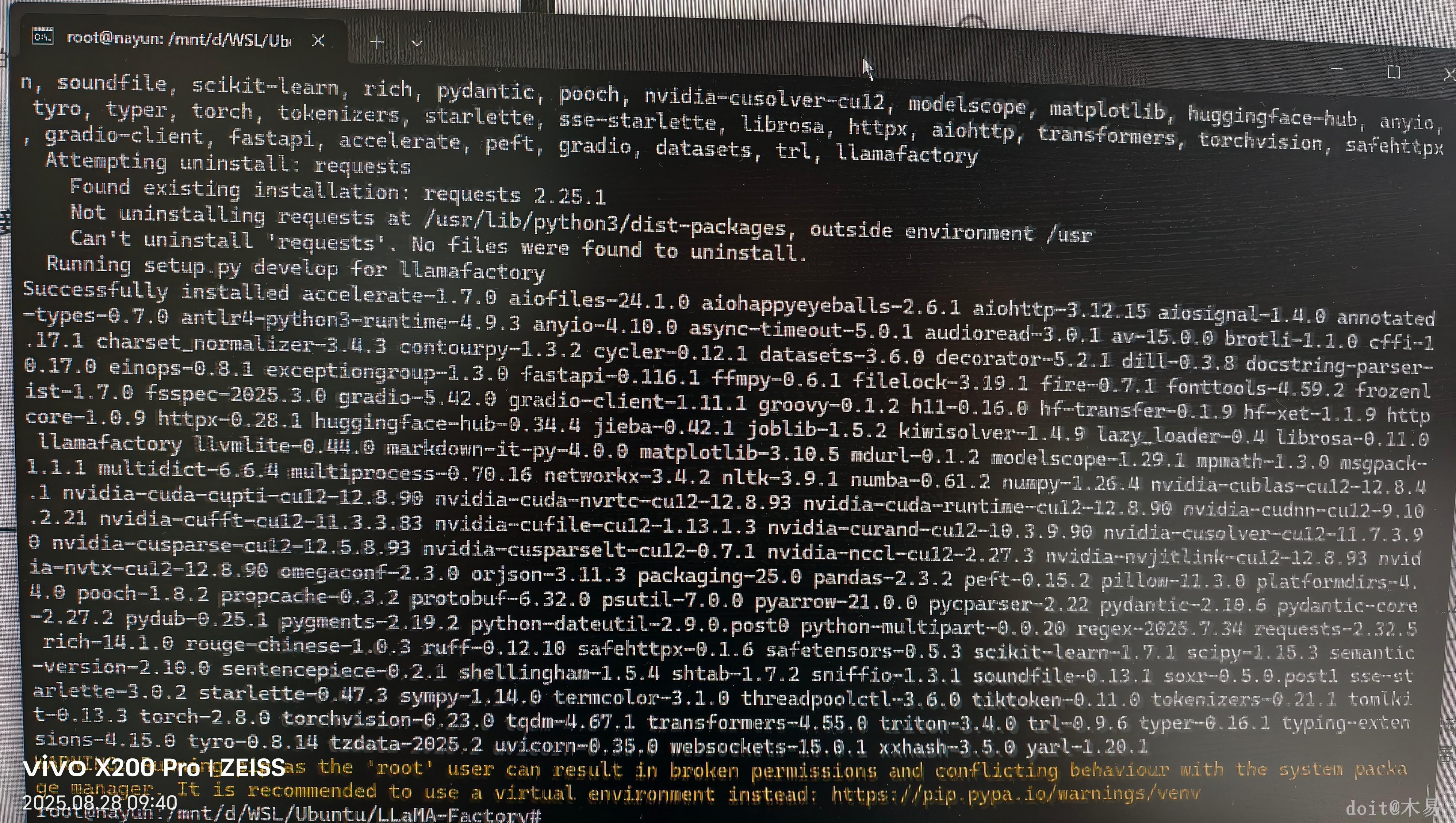

拉取LLaMa-Factory

5

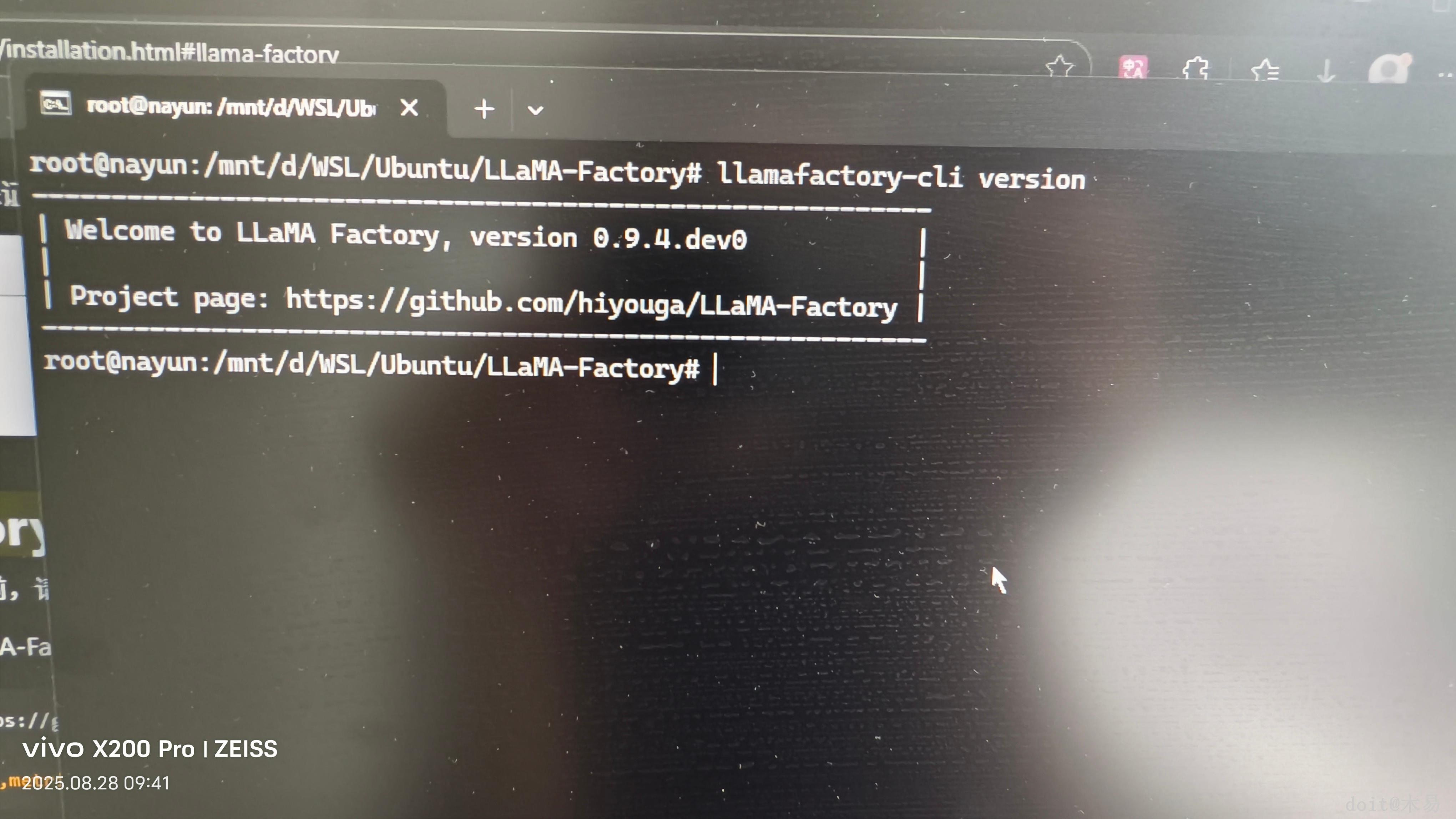

LLaMA-Factory 校验

0

0 0

0 0

0猜你喜欢

评论/提问(已发布 0 条)

0

0

qq空间

qq空间  微博

微博  复制链接

复制链接  分享

分享